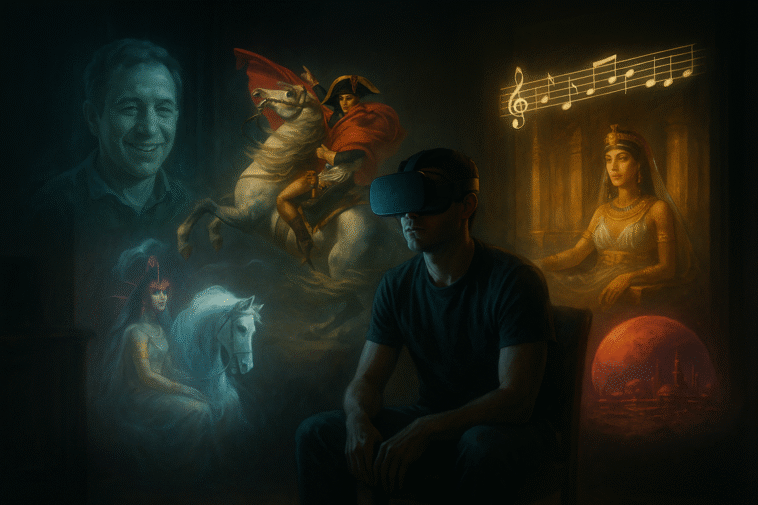

Face à l’explosion des IA immersives, chacun pourra bientôt vivre dans un monde qui répond à ses désirs. Deuil, fantasmes, conquêtes impériales ou musiques inédites : comment gérer la fragmentation psychique et sociale qui s’annonce ?

Les IA immersives permettront de recréer nos proches disparus, de vivre comme Napoléon ou Cléopâtre, ou d’écouter des musiques inédites générées au-delà des artistes. Mais cela peut rendre fous les plus fragiles. Études, chiffres, solutions et scénarios.

- Recréer les morts : les « griefbots »

- Vivre ses fantasmes : Napoléon, Cléopâtre, animaux et planètes

- Musiques IA transcendées

- Dangers psychiatriques : chiffres et études

- Connexions entre univers : Inter-World Protocol

- Qui gère ces univers ? Vers une AGI ou une gouvernance distribuée

- Solutions cliniques, juridiques et politiques

- Sources et références

1) Recréer les morts : les « griefbots »

Dès 2023, une étude de l’Université de Cambridge alertait sur les « hauntings » numériques, ces apparitions de proches décédés générés par IA. Selon Springer (2024), 36 % des personnes endeuillées interrogées accepteraient de dialoguer avec une version IA d’un défunt. Or, les psychiatres redoutent un risque de dépendance psychologique : le deuil, processus naturel, serait gelé dans une boucle artificielle.

2) Vivre ses fantasmes : Napoléon, Cléopâtre, animaux et planètes

L’IA ne se limite pas aux morts. Les plateformes immersives de demain permettront de choisir son rôle : être Napoléon à Austerlitz, Cléopâtre à Alexandrie, ou même un animal dominant. Une enquête de Pew Research (2024) montre que 54 % des 18-34 ans déclarent être prêts à passer plus de la moitié de leur temps libre dans un monde virtuel personnalisé. À l’échelle planétaire, cela représenterait plus de 1,2 milliard d’individus d’ici 2030, selon Statista.

3) Musiques IA transcendées

La musique est directement touchée : des modèles comme Suno ou Aiva apprennent l’intégralité des œuvres d’un artiste pour produire des compositions inédites « qu’il aurait pu écrire ». Selon un rapport de Goldman Sachs (2024), l’IA musicale pourrait représenter un marché de 3,3 milliards $ d’ici 2030. Mais ce progrès entraîne une dilution du sens commun : chacun écoute « sa » version d’un artiste, rendant l’expérience collective de la musique obsolète.

4) Dangers psychiatriques : chiffres et études

Déjà en 2022, l’OMS signalait que 15 % des adolescents présentaient des symptômes de déréalisation liés aux environnements VR. Une étude dans Frontiers in Virtual Reality (2025) montre que des sessions prolongées au-delà de 90 minutes augmentent de 47 % le risque de dissociation. Le psychiatre français Boris Cyrulnik résumait ainsi : « L’homme a besoin d’une histoire commune pour rester sain. Les mondes IA menacent ce récit partagé. »

5) Connexions entre univers : Inter-World Protocol

Pour éviter l’isolement complet, des chercheurs du Metaverse Standards Forum et du W3C travaillent déjà sur une interopérabilité des mondes virtuels. Nous proposons un Inter-World Protocol (IWP) : un standard qui permettrait à un individu d’ouvrir temporairement son univers à d’autres, avec des garde-fous cliniques (durée, intensité sensorielle, consentement explicite).

6) Qui gère ces univers ? Vers une AGI ou une gouvernance distribuée

Certains imaginent une AGI quantique contrôlant et reliant tous ces mondes. Mais un tel système concentrerait un pouvoir colossal, rappelant la dystopie de Matrix. L’option la plus réaliste est une gouvernance polycentrique, avec :

- L’Union européenne, via l’AI Act, qui impose déjà transparence et contrôle des IA génératives.

- Les plateformes (Meta, OpenAI, ByteDance) forcées de publier des rapports d’exposition et de risques.

- Des tiers indépendants (ONG, universités) pour auditer et certifier la sécurité psychologique des mondes IA.

7) Solutions cliniques, juridiques et politiques

Pour limiter le risque de folie collective :

- Seuils d’illusion : limiter la durée à 60 minutes consécutives, comme recommandé par Frontiers in Psychiatry.

- Consentement post-mortem : interdire les avatars de défunts sans autorisation explicite donnée de leur vivant.

- Ancrages de réalité : obliger l’insertion de rappels contextuels (horloge, météo, repères sociaux).

- Éducation numérique : former dès le collège aux risques de dissociation et d’addiction immersive.

- Sanctions : appliquer les amendes de l’AI Act (jusqu’à 35 M€ ou 7 % du CA mondial).

8) Sources et références

- Cambridge — Griefbots (2023)

- Springer — Ethics of Grief Tech (2024)

- The Guardian — Deathbots (2025)

- Frontiers in Virtual Reality — Immersion et dissociation (2025)

- Commission européenne — AI Act (2024)

- Goldman Sachs — AI et musique (2024)

- Statista — Taille du marché Metaverse (2025)